Cos'è LaMDA? La comprensione del linguaggio naturale secondo Google

Sul palco di Google I/O 2021, Sundar Pichai presenta LaMDA, l'ultimo passo avanti di Google in termini di NLU (Natural Language Understanding). La comprensione del linguaggio naturale accelera notevolmente.

Sundar Pichai, CEO di Google, ieri ha presentato LaMDA sul palco dell'evento più attesi del momento: Google I/O 2021.

Cos'è LaMDA?

LaMDA, acronimo di Language Model for Dialogue Applications, è un potente algoritmo di Google per la comprensione del linguaggio naturale, presentato durante l'evento Google I/O 2021.

Siamo nell'ambito di ciò che viene definito Natural Language Understanding (NLU), e di fatto si tratta di un sistema in grado di rendere più naturali le conversazioni tra l’intelligenza artificiale (AI) e gli utenti.

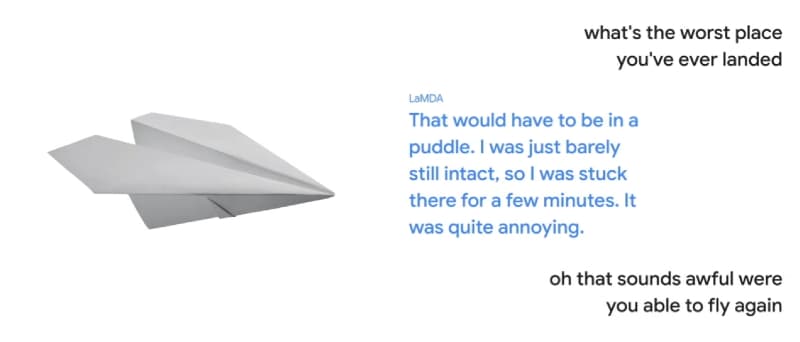

Durante l'esposizione è stata mostrata una conversazione che definire "incredibile" in cui LaMDA è entrato in azione nei panni di Plutone e di un aeroplanino di carta. Ha risposto perfettamente a tono alle domande, utilizzando anche battute e rendendo il dialogo fluido e piacevole.

Nei panni di Plutone, alla domanda..

What else do you wish people know about you?

l'algoritmo ha risposto..

I wish people know that I am not just a random ice ball. I am actually a beautiful planet.

LaMDA non dispone di risposte predefinite nel proprio sorgente, ma genera le frasi istantaneamente, in base al modello generato dal training del Machine Learning basato sulle informazioni che gli vengono fornite.

Come molti modelli di linguaggio recenti, inclusi BERT e GPT-3, è basato su Transformer, un'architettura di rete neurale che Google ha creato e reso open source nel 2017. Tale sistema produce un modello che può essere addestrato per assimilare molte parole (es. una frase o paragrafo), a captare come queste si relazionano tra loro, per poi predire quali parole sono statisticamente indicate per proseguire.

Ma a differenza della maggior parte degli altri modelli linguistici, Google afferma di aver addestrato questa tecnologia al dialogo.

But unlike most other language models, LaMDA was trained on dialogue. During its training, it picked up on several of the nuances that distinguish open-ended conversation from other forms of language. One of those nuances is sensibleness. Basically: Does the response to a given conversational context make sense?

Il sistema attualmente non è in produzione, ma Google sta lavorando a questa tecnologia per essere utilizzata in prodotti come Assistant, Search e Workspace.

Nel post di presentazione sul blog (riporto il link negli approfondimenti), Google afferma che l'obbiettivo è rendere le risposte di LaMDA "convincenti", ma soprattutto "corrette".

Being Google, we also care a lot about factuality (that is, whether LaMDA sticks to facts, something language models often struggle with), and are investigating ways to ensure LaMDA’s responses aren’t just compelling but correct.

Per approfondire